Über mich

Studium

Forschung

Kontakt

Projekte:

GetThemAll Heise TrollEx

Robocup Rescue

In den Jahren 2004 und 2005 war ich sehr aktiv im Bereich Robocup Rescue, welches ein Teil von Robocup ist. Bei Robocup geht es darum Roboter zu entwickeln, die gegeneinander in Teams antreten und Fußball spielen. Das ehrgeizige Ziel ist es, bis 2050 ein Roboterteam zu entwickeln, das gegen das menschliche Weltmeisterteam gewinnt.

Bei Robocup Rescue geht es hingegen nicht darum den Robotern ein Spiel beizubringen, sondern um die Rettung von Menschenleben. Ziel ist es hier Roboter zu entwickeln, die autonom (d.h. selbständig, ohne Fernsteuerung durch einen Menschen) in einsturzgefährdeten oder bereits teilweise verschütteten Gebäuden nach überlebenden suchen und dabei automatisch eine "Landkarte" erstellen in denen passierbare Wege und überlebende Menschen eingetragen werden. So weiß das Rettungsteam ob es sich lohnt das Gebäude zu betreten und wo sich überlebende befinden. Roboter sollen auch anhand von Wärme, Bewegung, Geräuschen und CO2-Werten erkennen in welchem Zustand sich ein Opfer befindet.

Im Team ResqueRobots Freiburg waren wir in diesem Bereich aktiv und sehr erfolgreich.

Praktikum

Das Praktikum war mein Einstieg in den Bereich Robocup Rescue. Im Team mit drei weitere Kommilitonen war es unsere Aufgabe einen Pioneer II Roboter teleoperierbar zu machen. Dazu bauten wir einen Roboter um, der zuvor im Team CS Freiburg Fußball spielte.

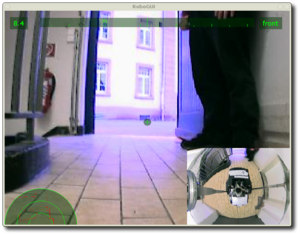

Der Roboter bekam hardwareseitig zu seinem Laserscanner drei Firewire Kameras (Ansicht für vorne, hinten und Überblick (Omni-View)), einen 3D Kompass sowie größere Räder, eine spiegelnde Glaskugel für die Omni-view und ein Mininotebook, das per WLAN kommunizierte. Softwareseitig entwickelten wir eine komplette Teleoperationssoftware, welche alle Daten des Roboters darstellte und diesen mit Joystick/Joypad und Tastatur steuern konnte. Wir erreichten unser Ziel, so dass sich der resultierende Roboter wie gewünscht teleoperieren ließ.

Mehr Material

Bild 1 Bild 2 Bild 3 Bild 4 Bild 5 Bild 6 Bild 7 Bild 8 Vortragsfolien

Seminar: Gesicht und Handerkennung

Nach dem Praktikum belegte ich noch ein Seminar in Bereich Robocup Rescue. Das Thema meines Vortrags war die Gesicht- und Handerkennung. Da die Rettungsroboter meistens mit Kameras ausgestattet sind, kann eine (automatische) Erkennung von Gesichtern und Händen dabei helfen zu Entscheiden, ob eine Wärmequelle nun tatsächlich ein Opfer ist, oder ob es sich dabei nur um warmes Gestein handelt.

Vortrag und Ausarbeitung basierten auf Robust Real-time Object Detection von Paul Viola und Michael Jones (2001) Robust Hand Detection von Mathias Kölsch and Matthew Turk (2004)

German Open im April 2005, Paderborn

Nach meinem Praktikum und dem Seminar war ich am Lehrstuhl für Grundlagen der Künstlichen Intelligenz (Prof. Dr. Bernhard Nebel) als Wissenschaftliche Hilfskraft angestellt. Zusammen im Team entwickelten wir die Software aus dem Praktikum weiter und bauten zwei neue Roboter.

Ein Roboter war geländefähig. Seine Basis bestand aus einem Spielzeug mit Gummiketten, das wir aus Amerika importierten. Wir entfernten das Gehäuse und ersetzten die Funkfernsteuer Elektronik, so dass der Roboter über USB von einem auf dem Roboter befestigten Mininotebook gesteuert werden konnte. Das Notebook nahm per WLAN Verbindung auf und hatte zwei modifizierte USB-Webcams, so dass der Roboter mit der Software aus dem Praktikum teleoperierbar war.

Der zweite Roboter war für die Ebene ausgelegt und bereits auf dem besten Wege autonom zu agieren. Er hatte mehrere Ultraschall- und Infrarotsensoren.

Mit unserem Geländefähigen Roboter waren wir eine der wenigen, die es über das Stepfield oder die Treppe hoch geschafft haben. Das Stepfield bestand aus unterschiedlich hohen Holzklötzen und deren Überquerung war teilweise die Bedingung die Arena überhaupt zu betreten. Auch auf zweier Etage gab es einige Opfer zu entdecken, so dass das erklimmen der Treppe viele Punkte einbrachte.

Auf dem Siegertreppchen holten wir uns den zweiten Platz.

Mehr Bilder

Frühe Version des "Zerg"

Teleoperationsoberfläche für die Zuschauer

Bild 1

Bild 2

Bild 3

Bild 4

Bild 5

Bild 6

Bild 7

Bild 8

Bild 9

Bild 10

Bild 11

Weltmeisterschaft in Osaka (Japan) im Juli 2005

Für die Weltmeisterschaft in Japan konstruierten wir unsere Roboter neu. Der geländefähige "Lurker" bekam an Stelle der ausfahrbaren Kamerahalterung einen Überrollbügel. Sollte er trotzdem mal beim Versuch die Treppe zu erklimmen auf dem Rücken oder Seite liegen bleiben oder sollte er im Stepfield stecken bleiben, so konnte der Operator auf einen der anderen zwei Lurker umschalten und mit diesem weiterfahren.

Auch der "Zerg" wurde neu konstruiert und in doppelter Aufführung hergestellt. Beide hatten einen kleinen Laserscanner mehrere Infrarot- und Ultraschallsensoren, jedoch nur einer hatte eine Wärmebildkamera. Dieser Roboter fuhr vollständig autonom durch die völlig unbekannte Arena und fand die Opfer mit Hilfe der Wärmebildkamera. Mit Hilfe des Laserscanners erstellte er eine Karte der Landschaft in welche die gefundenen Opfer eingetragen wurden.

Unsere Mühen wurden mit dem ersten Platz in der Kategorie der autonomen Roboter belohnt. Aber auch in der Hauptkategorie sind wir mit einem vierten Platz nur knapp am Siegertreppchen vorbei und verwiesen viele Teams auf die hinteren Plätze.

Weitere Bilder

Beim Setup des ZergSiegerehrung

Weiteres Material

Artikel auf Heise-online

Publikation: Team Description Paper

Seminar: Familienpolymorphismus

Abseits von Robocup Rescue belegte ich ein Seminar zu Java am Lehrstuhl für Programmiersprachen (Prof. Dr. Peter Thiemann) mit dem Titel "Java - Grundlagen und Erweiterungen". Mein Thema handelte von einem Konzept, das es in Java noch nicht gibt: Den Faminienpolymorphismus. Daher beschäftigte ich mich Größtenteils mit der Programmiersprache gbeta, welche eine Generalisierung der Programmiersprache BETA darstellt. Grundlage meiner Arbeit ist der Artikel Family Polymorphism von Erik Ernst. Da Java zum Erscheinungszeitpunkt des Artikels noch keine Generics kannte, versuchte ich den Familienpolymorphismus mit Hilfe von Generics nachzubilden. Jedoch lässt sich auch mit Generics kein Familienpolymorphismus nachbilden, auch wenn man nahe dran kommt.

Material

Ausarbeitung und Folien.

Seminar: Wissenspsychologie

Für das Hauptstudium wechselte ich mein Nebenfach von Mathematik zu Psychologie. Dafür besuchte ich einige Seminare, unter anderem auch Wissenspsychologie bei Prof. Dr. Hans Spada und Dr. Nikol Rummel. In kleinen Gruppen bearbeiteten wir verschiedene Themen und präsentierten dies der Teilnehmergruppe. Mein Beitrag zu dem Seminar hatte die Debatte zwischen Clark und Keysar zum Thema.

Material

Folien und Ausarbeitung.

Studienarbeit: Navigation in Videos mit kreisförmigen Benutzerschnittstellen

Für die Studienarbeit begab ich mich thematisch wieder in ein neues Gebiet: Die Erforschung neuartiger Benutzerschnittstellen. Hierfür implementierte ich mehrere Varianten einer kreisförmigen Benutzerschnittstelle für die Navigation in Videos. Unter anderem eine positionsbasierte Variante, eine geschwindigkeitsbasierte Variante und eine Variante, mit der man sowohl positionsbasiert, als auch geschwindigkeitsbasiert navigieren kann. Einen Großteil der Studienarbeit machte die Evaluation der implementierten Benutzerschnittstellen aus. Denn was nützen neuartige Benutzerschnittstellen, von denen man nicht weiß, ob sie sinnvoll und intuitiv benutzbar sind. Hier kam mir das Psychologieseminar "Empirisch Forschen lernen" aus meinem Nebenfach zugute.

In der Evaluation wurden nicht nur die verschiedenen Varianten untereinander verglichen, sonder auch mit verschiedenen Eingabegeräten getestet. Die zwölf Probenden sollten dabei mit verschiedenen Devices und Slidervarianten bestimmte Szenen und Bilder in Videoclips ausfindig machen.

Das von den Probanden am liebsten benutzte und am besten bewertete Device ist der Stift, recht dicht gefolgt von der Maus. Das Touchpad wurde im allgemeinen nicht gerne benutzt. Bei den Slidervarianten variierten die Ergebnisse je nach verwendetem Device. Probanden mit Touchpad bevorzugten einen Slider zum Spulen (geschwindigkeitsbasiert). Probanden mit Stift hatten mit dem Ausführen von Kreisbewegungen weniger Probleme und bevorzugten für kurze Strecken eher die positionsbasierte Variante, welche naturgemäß schneller auf Richtungsänderungen der Benutzer reagiert. Die gemischte Variante schnitt in allen Kategorien gut ab.

Die Evaluation hat gezeigt, dass sich ein rundes Interface durchaus für die Navigation in Videos eignet und dass sich kreisförmige Bewegungen auch gut mit einer Standard Computermaus ausführen lassen. Das Touchpad ist überraschenderweise bei weitem nicht so gut geeignet, obwohl sich hier die Kreisbewegungen, genau wie beim Stift, gut aus dem Handgelenk ausführen lassen.